Yapay zekâ araştırmacıları 'deepfake' videoları tespit etmek için çalışmaları hızlandırdı

Yapay zekâya odaklanan birçok araştırmacı, son dönemlerde popüler hale gelen 'deepfake' videolarla ilgili harekete geçti.

Siyasetçilerin fotoğraf ya da videoları üzerinde 'neredeyse kusursuz' oynama yapan yapay zekâ yazılımları, insanların farklı yönlendirilmesine sebep olabiliyor.

Yapay zekâ çalışmaları bazen korkutucu boyuta ulaşabiliyor. Özellikle de 'deepfake' konusu insanların kafasını epey karıştırıyor. Samsung'un birkaç hafta önce ortaya çıkan çalışmaları aslında bunun en somut örneği. Şu anda tek bir statik fotoğrafı analiz eden yapay zekâ, fotoğraftan basit materyaller yardımıyla video elde edebiliyor.

Mona Lisa'nın tek bir fotoğrafına odaklanan Samsung'un deepfake yapay zekâsının yaptığı da tam olarak bu. Sonuç olarak tamamen gerçek gibi görünen bir video ortaya çıkıyor.

Bu tür tekniklerle alakalı olarak Dartmounth araştırmacısı Hany Farid'in bir açıklaması var; Farid kısaca bu tekniklerin çok az veri gerektirdiğinden bahsediyor. Yani aslında elde edilen çok az veriyle sofistike ve çekici içerikler üretilebiliyor.

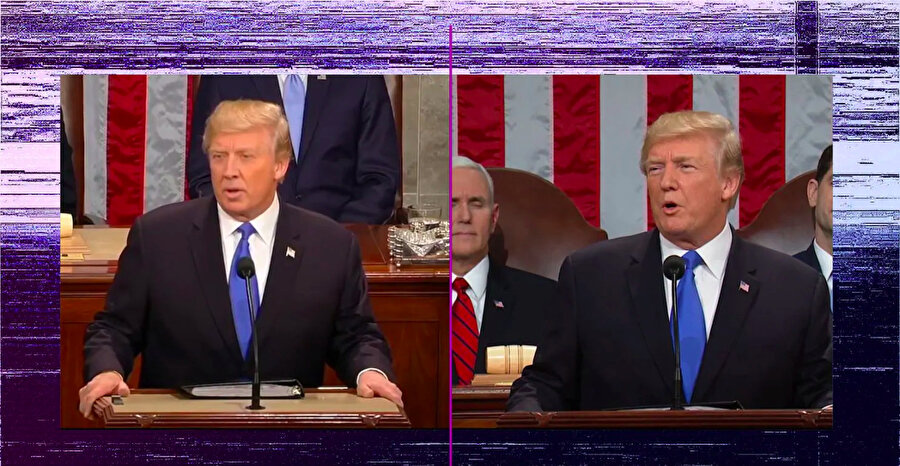

Elbette deepfake yapay zekânın en net kullanım alanlarından biri ise siyaset. Fotoğraf ya da videoların değiştirilip dönüştürülmesiyle oluşturulan yeni videolar siyasiler için can sıkıcı boyuta ulaşıyor. Evet; böyle bir gerçek var ve dolayısıyla bir yandan da bunlarla mücadele etmek gerekiyor.

İnsanları yanlışa yönlendirebilecek sahte videolar, ülkelerin kaderinde belirleyici boyuta ulaşabilir. Şu anda araştırmacılar da sahte videoları analiz edebilen; ışığı, gölgeleri, yanıp sönen desenleri ve diğer birçok parametreyi göz önünde bulunduran çeşitli materyaller üzerinde çalışıyor.

Araştırmacılar yapay zekâ tarafından oluşturulan bu tip videoların ABD'de henüz politikada tam anlamıyla kullanılmadığını söylüyor. Ancak mevcut videolara yapılan basit düzenlemelerin bile kargaşaya sebep olabileceği düşünülüyor.

San Francisco'da bir makine öğrenim laboratuarı olan Fast.ai'nin kurucu ortağı olan Rachel Thomas, derin öğrenmenin kullanıldığı bir dezenformasyon kampanyasının, şok edici derecede büyük kitlelere kısa sürede ulaştığını söylüyor. Yani aslında durum çok ciddi. Dolayısıyla önlem alınması şart.